حافظه مهارت محور (Procedural Memory) با چارچوب Memp وارد فاز اجرایی شده و بازی را برای ایجنتهای هوش مصنوعی تغییر میدهد. به جای شروع هر کار از صفر، ایجنتها تجربههای قبلی را به «مهارتهای قابل انتقال» تبدیل میکنند؛ نتیجه؟ کاهش هزینه، کاهش پیچیدگی، کاهش مصرف توکن و افزایش نرخ موفقیت در وظایف طولانی و چند مرحلهای؛ از برنامه ریزی سفر تا کارهای خانگی شبیه سازی شده. این رویکرد روی مدلهای روز مانند GPT-4o، Claude 3.5 Sonnet و Qwen2.5 آزمایش شده و نوید خودمختاری ایجنتها در اتوماسیون سازمانی را میدهد.

حافظه رویهای چیست و چرا برای ایجنتها حیاتی است؟

حافظه مهارتی در انسان مهارتهایی مثل تایپ یا دوچرخه سواری را به «رفتار خودکار» تبدیل میکند. در ایجنتهای هوش مصنوعی نیز همین ایده باعث میشود دنباله کارها به صورت مهارت محور اجرا شوند؛ بدون باز پردازش کامل هر بار. این حافظه بلند مدت با تکیه بر تجربه، زمان پاسخ و منابع محاسباتی را کاهش میدهد و مسیر انجام وظیفه را کوتاه میکند.

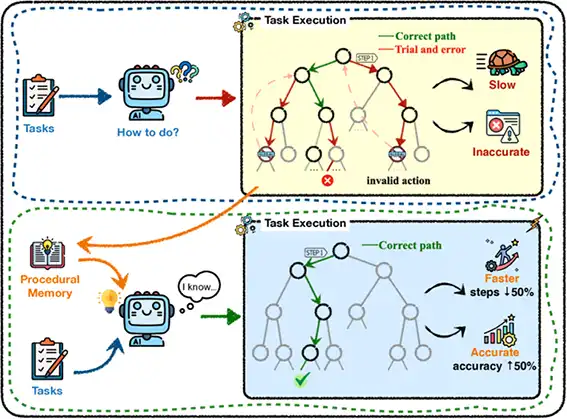

Memp چگونه کار میکند؟ (ساخت/بازیابی/به روزرسانی)

چارچوب Memp، حافظه رویهای را به یک مؤلفهی مرکزی تبدیل میکند و آن را در یک چرخهی پیوستهی ساخت (Build)، بازیابی (Retrieve) و به روزرسانی (Update) بهینه میسازد.

ساخت: از مسیرهای گذشتهی (Trajectory) ایجنت (گام به گام) یا خلاصههای سطح بالا، اسکریپت استخراج میشود.

بازیابی: با جستجوی برداری یا استخراج کلید واژه، نزدیکترین الگو به کار فعلی را پیدا کرده و دوباره به کار میگیرد.

به روزرسانی: خاطرات موفق اضافه میشوند؛ مهمتر اینکه خطاها بازتاب و اصلاح میگردند تا مهارتها فرسوده نشوند بلکه بالغ شوند. این رویکرد به حافظه توانایی تکامل دائمی میدهد؛ درست مثل فردی که هر روز چیز تازهای یاد میگیرد.

تفاوت با Mem0 و A-MEM

Mem0 و A-MEM بیشتر روی «به خاطر سپردن چیزهایی که رخ داده» در یک گفتگو/تعامل تمرکز دارند (دانش و حقایق). Memp اما روی «چگونه انجام دادن» در میان چندین تراژکتوری تمرکز میکند؛ یعنی همان حافظه مهارت محور که راه حلهای درست را به الگوهای از پیش ساخته بدل میکند و مانع اتلاف وقت در آزمون و خطا میشود.

نتایج عملی: از ALFWorld و TravelPlanner تا کاهش توکن و زمان

ارزیابی Memp در محیطهای چالش برانگیزی مثل ALFWorld (کارهای خانگی چن دمرحلهای) و TravelPlanner (وظایف جستجو و برنامه ریزی) نشان میدهد ایجنتهایی که حافظه مهارتی میسازند و بازیابی میکنند، گامهای کمتر برمیدارند، کاهش مصرف توکن دارند و نرخ موفقیت بالاتری کسب میکنند. سازمانها به روشنی میبینند که این رویکرد هزینه و پیچیدگی را در سطح گسترده مهار میکند.

انتقال دانش: از مدلهای بزرگ به کوچک

یکی از یافتهای مهم، انتقال حافظه مهارت محور است: میتوان رویههایی که یک مدل قدرتمند مانند GPT-4o استخراج کرده را به مدلهای کوچکتر مانند Qwen2.5-14B داد تا ضعفهای آنها در برنامهریزی بلندمدت و استدلال چندمرحلهای جبران شود. این یعنی موفقیت بالاتر و گامهای کمتر با هزینهی محاسباتی پایینتر. یعنی میتوان دانش را با مدلهای بزرگ به دست آورد اما اجرا را با مدلهای مقرون به صرفه پیش برد.

حل مشکل شروع سرد در سیستمها (Cold-Start)

بدون تراژکتوری طلایی، از کجا باید آغاز کرد؟ تیم پژوهشی توصیه میکند ابتدا یک شاخص ارزیابی محکم (Rule-based یا LLM-as-judge) تعریف شود؛ سپس اجازه دهیم مدلهای SOTA در چارچوب ایجنت کاوش کنند و بهترین تراژکتوریها (مسیر و الگو ) به صورت خودکار به حافظه وارد شوند. این روش باعث بوت استرپ یا راه اندازی سریع حافظه مهارت محور میشود، بدون اینکه به مهندسی دستی سنگین نیاز باشد .

چرا این رویکرد هزینه و پیچیدگی را واقعاً کاهش میدهد؟

- تکرا کمتر: به جای باز کاوی هر مسیر، ایجنت از رویههای تثبیت شده بهره میبرد.

- بهینه سازی مصرف توکن: خلاصه سازی اسکریپتی و بازیابی هدفمند باعث کاهش فراخوانیهای پرهزینه و کوچکتر شدن مکاتبات در هر گام میشود.

- تعادل هزینه/کیفیت: با انتقال دانش، تصمیم گیری سطح بالا توسط مدل بزرگ انجام و اجرا توسط مدل کوچک انجام میشود.

- کاهش بار مهندسی: به روزرسانی مستمر حافظه (با تصحیح خطا) نیاز به بازنویسی مداوم پرامپتها و مهندسی دستی را کم میکند.

این جمع بندی با گزارشهای اخیر و نتایج Memp همسو است.

نقشه راه عملی برای تیمهای محصول و داده

- شناسایی فرآیندهای تکرار شونده ( (Service Desk، سفارش گیری، تطبیق اسناد که از رویههای قابل انتقال سود میبرند.

- طراحی معیار ارزیابی( Rule-based یا LLM-as-judge ) برای سنجش کیفیت خروجی در هر گام.

- اجرای یک Proof-of-Value (ساخت اولیه حافظه با مدل بزرگ مثلاً GPT-(4o، سپس انتقال دانش به مدل مقرون به صرفه جهت استقرار.

- پایش مداوم: ثبت تراژکتوریها، بازتاب خطاها و سیاست منقضی سازی برای جلوگیری از تورم حافظه.

- یکپارچه سازی ابزارها: استفاده از جستجوی برداری و چارچوبهای ارکستراسیون (مانند لایههای حافظه در LangGraph برای بازیابی دقیق Langchain . )

نتیجه گیری

با Memp، ایجنتهای هوش مصنوعی به کارکنان دیجیتال مهارت محور ارتقا مییابند. حافظه مهارت محور مسیر انجام کار را کوتاه میکند، مصرف توکن را پایین میآورد و نرخ موفقیت را افزایش میدهد؛ و مهمتر از همه، کاهش هزینه و پیچیدگی را در استقرارهای سازمانی ممکن میسازد. اکنون زمان آن است که یک لایه حافظه بلند مدت برای ایجنتهای خود بسازید و ارزش واقعی اتوماسیون را تجربه کنید.